中国是全球最大的水产品加工和出口国,至2023年中国水产养殖产量已连续32年稳居世界第一[1]。鱼类在水产品产量中占比最大,是人类重要的食物来源,同时也是维护地球生态平衡的重要组成部分[2],合理开发和利用鱼类资源对于水体生态保护和渔业资源的可持续利用具有重要意义[3]。观察、识别鱼类能够提供水域生态系统的信息,并为制定有效的保护和管理策略提供数据基础。通过观察鱼类的种群数量变化、行为表现和鳞片特征分别可以反映鱼类资源的健康状况、评估水域的环境情况及预防细菌性疾病的暴发[4-6]。因此,识别鱼类对渔业经济发展、国家粮食安全和生态保护都具有重大意义。目前鱼类识别以人工观察和传统机器学习方法为主[2],其中,人工识别方法费时费力且带有主观因素,此外,人工接触后的鱼体会产生应激反应,这对鱼类的生长极为不利[7];传统机器学习方法避免了对鱼体直接接触,但仍需人工提取特征并根据不同问题设计不同的图像向量化方法[8];而深度学习方法凭借可获得更高级的特征、挖掘更多数据特征分布规律、实现端到端输入输出及对所有问题均能采用同一个流程解决的优点吸引了众多研究者。

近年来,随着智慧渔业、精准养殖等概念的兴起,深度学习方法在鱼类识别任务上的应用也越发普及。除去深度学习技术上普遍存在的检测小目标、重叠或遮挡目标等问题,将深度学习方法应用到鱼类识别任务上还必须面临其他方面的难题。一是数据质量低,这是深度学习在该领域应用需要面对的首要问题。因水域环境多变,水体中光照不均、含有悬浮颗粒和其他水生生物的干扰,再加上硬件设备配置的约束,这容易使得获取的水下图像出现纹理模糊、颜色失真等现象[9-10]。二是鱼类物种繁多。不同种类的鱼之间可能会存在非常大的特征差异,若是将已训练好的模型泛化到其他鱼类的识别任务上,往往需要重新调节参数,甚至还面临重新构建模型的风险。三是更高维度下鱼类多了一个可垂直移动的维度,这显著提升了水下目标的难度。为了早日解决这些难题,推动深度学习技术在鱼类识别任务上的应用发展,研究者需要快速了解领域现状,准确抓住这些难题的切入点。因此,本文筛选了2020年1月—2024年1月发表的文章,对该领域相关研究进行了综述,以期促进深度学习在鱼类识别任务中的应用发展。

1 深度学习在鱼类识别方面的应用发展

深度学习又被称为端到端学习,它通过组合简单的非线性模块,使每个模块将输入的数据转换为更高级的抽象表示,从而使计算机能够学习到非常复杂的数据信息[11]。目前深度学习在鱼类识别任务上应用最为广泛的是基于卷积神经网络(convolutional neural network,CNN)的模型。卷积神经网络主要由输入层、输出层、卷积层、池化层和全连接层构成,因其卷积层的特征提取能力而被广泛应用到图像处理任务上[12]。随着深度学习的发展,在几个关键时间节点上诞生的模型推动了深度学习与鱼类识别应用的结合。

1)Fast R-CNN。Fast R-CNN是2015年由Girshick等[13]提出的一种two-stage模型,它通过引入RPN将区域提取和特征提取合并到一个模型,避免了重复计算。而Fast R-CNN的多任务损失函数使其实现了端到端检测,检测速度和精度也比前期的VGG16、SPPNet、R-CNN有了显著提升。此外,它也是第一个被明确应用于鱼类识别任务且取得良好效果的深度学习模型[14]。该模型最初被应用在对监控视频数据中的鱼类计数,以及识别CLEF数据集中的鱼类,这对深度学习在鱼类识别任务上的应用研究具有里程碑意义。

2)ResNet。ResNet是2015年由He等[15]提出的一种模型,其在诞生时间上比Fast R-CNN要稍晚一些。虽然ResNet并未直接推动深度学习在鱼类识别应用上的发展,但它引入了一种革命性的残差结构。这种结构成功解决了深层神经网络中的梯度消失问题,使得训练更深的网络成为可能,从而显著提高了深度学习算法的性能上限。这不仅为后续的鱼类识别研究提供了新思路,还对深度学习在鱼类识别任务上的应用水平和识别效果有着深远影响。

3)FCN。FCN是2015年由Long等[16]提出的一种模型,它是首个具有端到端输入输出能力的图像分割神经网络。虽然FCN提出的时间比Fast R-CNN稍早,但其应用到鱼类识别任务上的时间要比Fast R-CNN要晚得多。由于图像分割比一般的识别算法更为细致,是像素级别的分类,因此在鱼类识别任务中,使用分割神经网络能够获得更多的轮廓信息,从而实现更加细致、准确的识别。尽管在深度学习与鱼类识别任务的结合初期就已经存在使用分割算法提高模型精度的研究,但这些研究中的模型并不是端到端输入输出的系统,需要人为干预才能完成识别。而FCN的出现使得图像分割应用更加智能和便捷,从而促进了鱼类识别向精细化识别发展。

4)YOLO。YOLO算法最早的版本由Redmon等[17]于2016年提出,尽管在将YOLO算法应用到鱼类识别之前,就已经有了许多检测效果不错的神经网络模型,但这些模型的实时性较差,难以投入实际场景中应用。而YOLO算法的出现打破了这一僵局。YOLO算法是第一个实现工业级实时性的深度学习模型,其能够一次性完成识别和定位,极大地提高了检测效率。凭借着检测的高效性,该算法能够适用于实际应用场景中的快速检测需求,这也就使得YOLO成为后续鱼类识别应用研究中最常用的模型之一。

5)MobileNet。MobileNet是在2017年由Howard等[18]提出的一种轻量化网络结构,它通过引入深度可分离卷积(depthwise separable convolutions,DSC)对每个输入通道进行空间卷积,以及引入点卷积对所有通道进行线性组合,从而大幅减少模型的参数和复杂度。凭借着这一特点,使得原本那些实时性低且结构复杂的模型,可以通过替换backbone为MobileNet提高其实时性,并降低其复杂度,进而使其适用于实际场景下资源受限的设备。MobileNet的诞生为后续在鱼类识别中的神经网络模型提供了一种简单且有效的改进思路。在现有的鱼类识别应用中,有多项研究都吸取了这种改进思路,将复杂模型的骨干网络替换为更加轻量化的网络结构。此外,MobileNet中的DSC和点卷积也成为了优化鱼类识别模型的宝贵思路。

6)Transformer。Transformer是在2017年由Vaswani等[19]提出,该模型引入了注意力机制,其在自然语言处理领域取得了突破性的进展,并逐渐应用到计算机视觉的任务中。Transformer的注意力机制使得模型可以更好地捕捉全局特征。近5年,有不少鱼类识别的应用研究中都受到了Transformer引入注意力机制的启发,也将注意力机制引入自己的模型中,提升模型对鱼类复杂特征的捕捉能力。Transformer模型的成功构建,为注意力机制融入鱼类识别任务奠定了重要基础。

2 构建鱼类识别数据集的方法

数据集的质量直接影响着模型的泛化能力和准确性。构建一个高质量数据集,需要满足数据量大、样本多样且数量平衡、标注准确且一致等条件。步骤:一是从采集设备或公开数据库中获取大量数据;二是对获取数据进行清洗,以去除噪声大且与研究无关的信息;三是准确标注数据,以保证模型学习的信息正确,充分平衡样本,以避免样本数量不均导致模型学习具有倾向性;四是根据场景和样本分布将标注好的数据划分为训练集、测试集和验证集。

在鱼类识别任务中,获取大量且数量平衡的高质量样本数据往往需要采集者在多地点、多时间段采集数据。这种地点跨度大,时间范围广的任务对研究者具有极高难度。尽管采用投放饵料吸引鱼群以加速获取有效数据,以及数据增强以扩充数据量等方法能够在一定程度上缓解这一难题,但仍难以满足对大量高质量数据的需求。

针对这个难题,研究者可以借助迁移学习的方法缓解数据量不足造成的困扰。迁移学习是将源任务中学到的知识迁移到新任务中,以辅助新任务的学习,进而提升新任务的学习效果[20]。其执行思路为在具有大量高质量数据的源任务数据集上进行预训练,通过微调以获得一个经过优化的模型预训练权重参数,然后再将所获得的预训练权重参数作为新任务训练的初始参数进行训练并微调,以适应新任务的识别特性。由于模型在源任务中习得关于目标边界、形态和颜色等组合特征的数据分布规律,这就使得模型迁移后可大幅减少新任务所需的训练数据量,加快模型的收敛速度,降低模型过拟合的风险,并提高模型最终的检测性能。

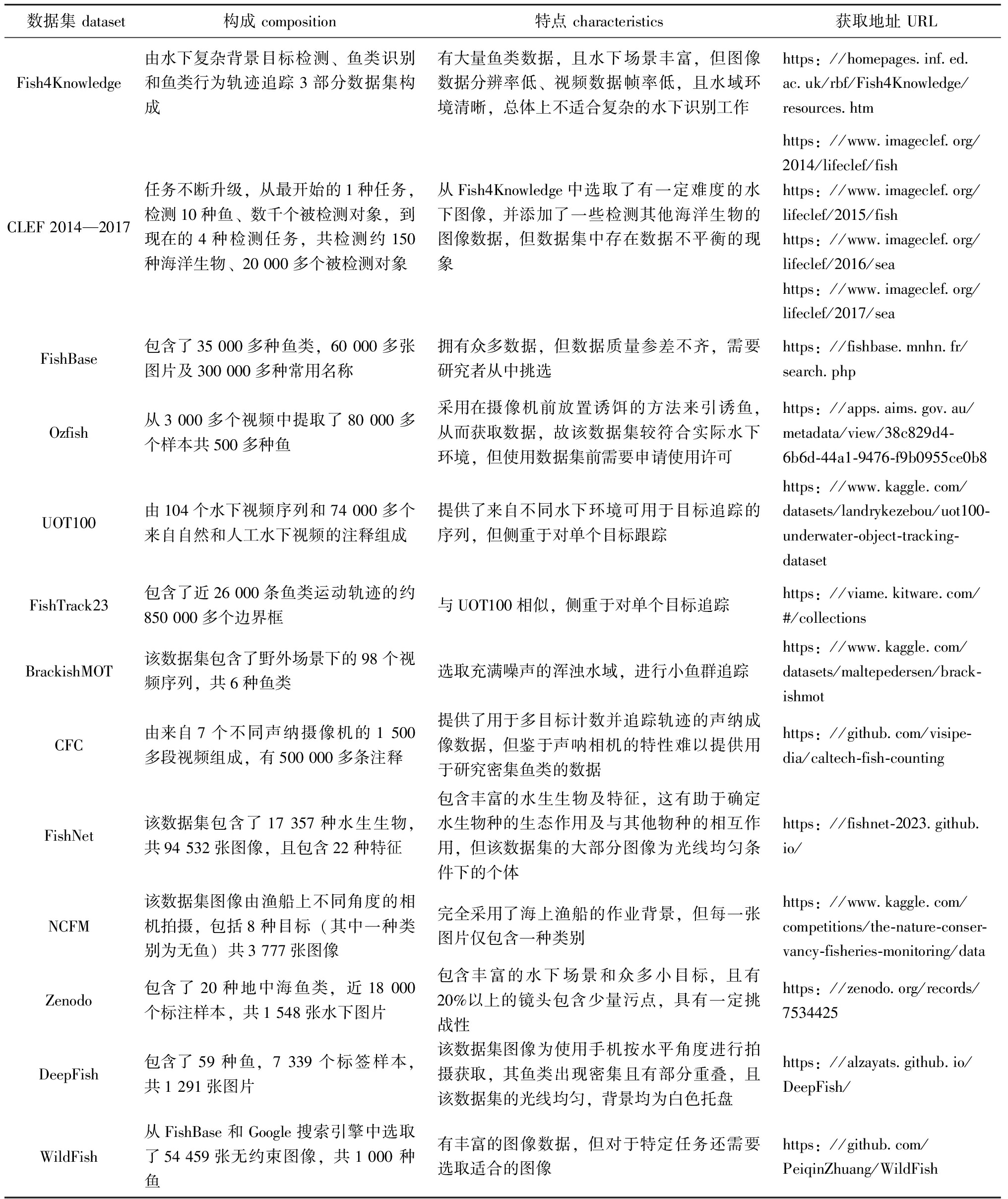

此外,在进行任务迁移时,源任务与新任务的相似性越大,其迁移效果通常就会更好。为了缓解获取大量研究所需数据的难题,同时减少研究者们寻找用于迁移学习的数据集所花费的时间,表1中列举了当下鱼类识别任务上使用较多的开源数据集,并叙述了这些数据集的构成和特点。

表1 鱼类识别任务常用的开源数据集

Tab.1 The open source datasets commonly used for fish recognition

数据集 dataset构成 composition特点 characteristics获取地址 URLFish4Knowledge由水下复杂背景目标检测、鱼类识别和鱼类行为轨迹追踪3部分数据集构成有大量鱼类数据,且水下场景丰富,但图像数据分辨率低、视频数据帧率低,且水域环境清晰,总体上不适合复杂的水下识别工作https://homepages.inf.ed.ac.uk/rbf/Fish4Knowledge/resources.htmCLEF 2014—2017任务不断升级,从最开始的1种任务,检测10种鱼、数千个被检测对象,到现在的4种检测任务,共检测约150种海洋生物、20 000多个被检测对象从Fish4Knowledge中选取了有一定难度的水下图像,并添加了一些检测其他海洋生物的图像数据,但数据集中存在数据不平衡的现象https://www.imageclef.org/2014/lifeclef/fishhttps://www.imageclef.org/lifeclef/2015/fishhttps://www.imageclef.org/lifeclef/2016/seahttps://www.imageclef.org/lifeclef/2017/seaFishBase包含了35 000多种鱼类,60 000多张图片及300 000多种常用名称拥有众多数据,但数据质量参差不齐,需要研究者从中挑选https://fishbase.mnhn.fr/search.phpOzfish从3 000多个视频中提取了80 000多个样本共500多种鱼采用在摄像机前放置诱饵的方法来引诱鱼,从而获取数据,故该数据集较符合实际水下环境,但使用数据集前需要申请使用许可https://apps.aims.gov.au/metadata/view/38c829d4-6b6d-44a1-9476-f9b0955ce0b8UOT100由104个水下视频序列和74 000多个来自自然和人工水下视频的注释组成提供了来自不同水下环境可用于目标追踪的序列,但侧重于对单个目标跟踪https://www.kaggle.com/datasets/landrykezebou/uot100-underwater-object-tracking-datasetFishTrack23包含了近26 000条鱼类运动轨迹的约850 000多个边界框与UOT100相似,侧重于对单个目标追踪https://viame.kitware.com/#/collectionsBrackishMOT该数据集包含了野外场景下的98个视频序列,共6种鱼类选取充满噪声的浑浊水域,进行小鱼群追踪https://www.kaggle.com/datasets/maltepedersen/brack-ishmotCFC由来自7个不同声纳摄像机的1 500多段视频组成,有500 000多条注释提供了用于多目标计数并追踪轨迹的声纳成像数据,但鉴于声呐相机的特性难以提供用于研究密集鱼类的数据https://github.com/visipe-dia/caltech-fish-countingFishNet该数据集包含了17 357种水生生物,共94 532张图像,且包含22种特征包含丰富的水生生物及特征,这有助于确定水生物种的生态作用及与其他物种的相互作用,但该数据集的大部分图像为光线均匀条件下的个体https://fishnet-2023.github.io/NCFM该数据集图像由渔船上不同角度的相机拍摄,包括8种目标(其中一种类别为无鱼)共3 777张图像完全采用了海上渔船的作业背景,但每一张图片仅包含一种类别https://www.kaggle.com/competitions/the-nature-conser-vancy-fisheries-monitoring/dataZenodo包含了20种地中海鱼类,近18 000个标注样本,共1 548张水下图片包含丰富的水下场景和众多小目标,且有20%以上的镜头包含少量污点,具有一定挑战性https://zenodo.org/records/7534425DeepFish包含了59种鱼,7 339个标签样本,共1 291张图片该数据集图像为使用手机按水平角度进行拍摄获取,其鱼类出现密集且有部分重叠,且该数据集的光线均匀,背景均为白色托盘https://alzayats.github.io/DeepFish/WildFish从FishBase和Google搜索引擎中选取了54 459张无约束图像,共1 000 种鱼有丰富的图像数据,但对于特定任务还需要选取适合的图像https://github.com/PeiqinZhuang/WildFish

3 深度学习在鱼类识别上的应用研究与分类标准

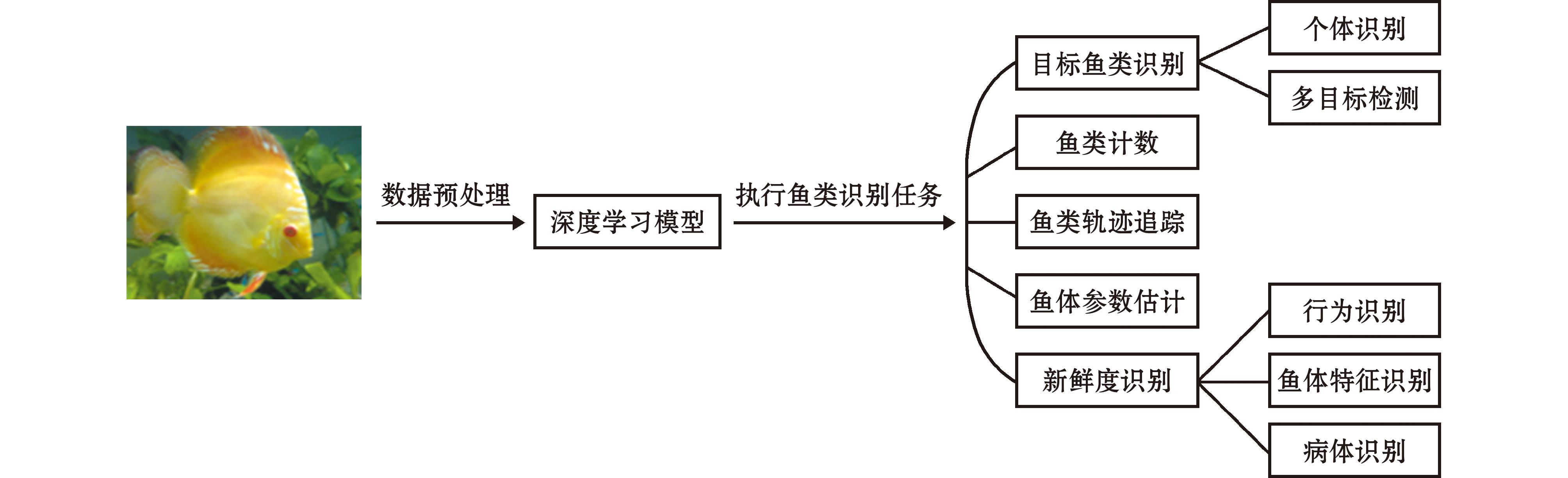

深度学习在鱼类识别任务上的应用可划分为目标鱼类识别、鱼体特征识别和鱼类行为识别3个大类,其具体划分如图1所示。

图1 深度学习在鱼类识别中的任务划分

Fig.1 Fish Recognition task classification in deep learning

通常认为图像仅包含一条鱼的是个体识别任务,而包含两条或两条以上鱼的是多目标识别任务。然而,基于以上标准划分任务无法区分任务的难度,如包含了密集且遮挡与不够密集且毫无遮挡的多目标鱼类数据集间会有非常大的识别难度差异,若将基于这两种数据集的研究都划分为多目标识别任务,这种划分方式必定存在争议。虽然在目标鱼类识别的任务划分上无明确定义,但可根据已有的鱼类识别研究进行聚类,并根据任务的特性和难度对其进行了区分,将个体识别与多目标识别研究的界限定义为该项研究是否考虑了鱼类之间相互遮挡的问题,若该研究有应对鱼类间相互遮挡的问题,则被划分为多目标识别任务,反之则被划分为个体识别任务。相比之下,计数和轨迹追踪任务的划分与个体和多目标识别任务之间的争议较小,通常可以将计数任务视为个体识别和多目标识别任务的拓展。而在轨迹追踪任务研究中,若添加了计数器对鱼进行计数,则可将其视为计数任务的拓展。

3.1 目标鱼类识别

3.1.1 个体识别 个体识别是鱼类识别中的基础任务,其对该领域的研究具有重大意义。当前,在个体识别任务上普遍需要应对实时检测、模糊场景下检测等问题。提高模型检测的实时性往往需要优化模型结构或减少模型参数量,而提高模糊场景下的检测能力则需要提高模型的表征能力。为实现这些目标,研究人员进行了多方面的改进。

在提高模型实时性方面,优化模型结构或减少模型参数量是主要方法。有些研究者采用轻量级MobileNet替换原模型中结构相对复杂网络[21-22]的方法,或是吸取了MobileNet的轻量化思想,使用深度可分离卷积或点卷积优化网络降低其复杂度[23]。

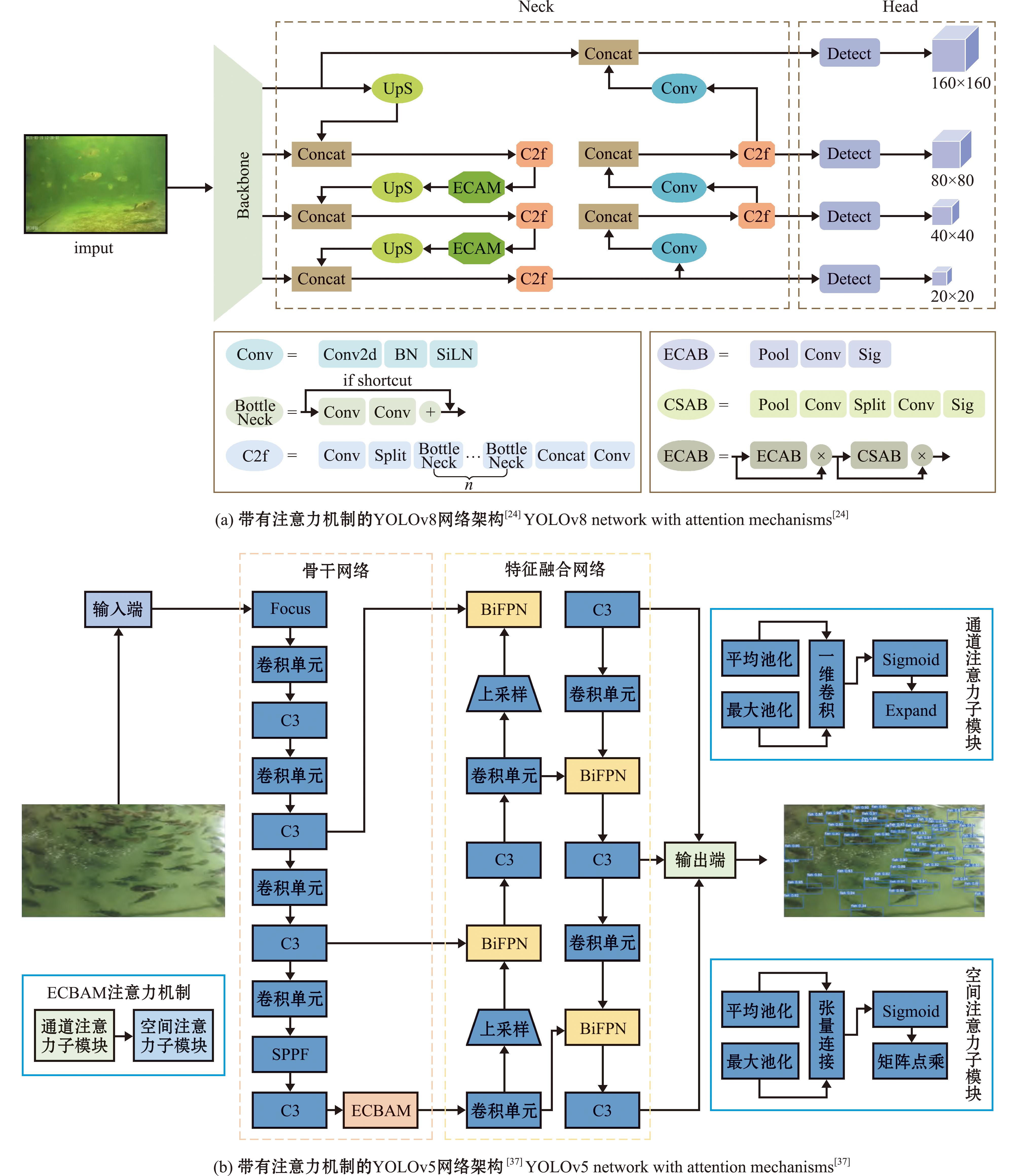

在增强模型准确性方面,研究者使用了多种技术。如对骨干网络添加特征金字塔网络(feature pyramid network,FPN)、自适应空间特征融合(adaptive spatial feature fusion,ASFF)模块和跨通道池化等能够融合被检测对象的尺度信息,进而提升模型的多尺度预测的精确度[22-26];添加挤压-激励(squeeze-and-excitation,SE)模块、空间协调注意力(efficient coordination attention module,ECAM)模块和选择性内核(Selective Kernel,SK)模块等注意力机制能够提高模型的表征能力[24,27-28];此外,RFB结构具有多尺度卷积、池化的特点,将其加入模型中既能提高模型的多尺度适应性,又能进一步提升模型的表征能力[22]。

在识别鱼类方面可以使用如下策略进一步提高效果:一是使用高斯混合模型与光流或轨迹追踪,相互校验临近的时间序列图像[29-30];二是采用旋转边界框的方式来增加其内部有效信息的比例,减少背景对有效信息的干扰[27];三是运用空间变换网络(spatial transformer networks,STN)使得模型在识别过程中对图像数据进行旋转、平移等空间变换,尽可能只保留含有鱼的部分,消去部分背景的干扰[31];四是采用彩色图像转灰度图像以降低计算的复杂度并减轻水下颜色吸收现象对识别造成的影响[23];五是给网络的head部分添加GhostBlock,以提高模型最终的预测能力[32];六是集成学习能进行数据增强或结合多个模型的输出结果[30,33-35]。

尽管当前已有许多实时性高、性能优异的鱼类个体识别模型,但真正将这些模型应用到实际场景并取得良好效果的研究仍然较少。因此,未来的发展方向应当着重于提高模型在实际应用场景中的鲁棒性和泛化能力,确保模型能够在不同环境下稳定高效地工作。

3.1.2 多目标识别 多目标识别任务是鱼类识别领域高级任务的核心,影响着后续的运动轨迹追踪、鱼群中的个体行为识别等任务的性能。所以多目标识别对深度学习在该领域的应用发展水平有着紧密的联系。

虽然鱼类的多目标识别任务难度与个体识别任务存在较大差异,但在增强模型识别准确性的方法上是十分近似的。基于多目标识别任务的研究也采用了跨通道特征融合的方法提高模型的多尺度检测能力[36],尽管这方面的研究还使用了不同于个体识别中的卷积块注意力(convolutional block attention module,CBAM)模块和高效通道注意力(efficient channel attention,ECA)机制[37],但这些方法的本质还是提升模型的表征能力。

当前鱼类的多目标识别数据采集环境通常来自于养殖场或围网。与个体识别的应用场景相比,在这些场景中采集的数据会有更多的噪声和鱼类之间的相互遮挡。鉴于多目标识别任务的复杂性,其需要使用一些新方法来解决这些问题:一是实时图像增强,以减少模糊对识别任务的影响[38];二是添加条件变分自编码器(conditional variational auto-encodes,CVAE),以修复水面镜面反射[39];三是透视矫正,以缓解物体近大远小对识别造成的影响[40];四是修改mask分支在模型中的位置,以达到分割辅助预测的目的[40]。

在复杂场景下,多目标识别的精度和实时性仍有提升空间,未来的研究应继续着重于提高模型的精度和实时性,以推动鱼类多目标识别的发展。

图2展示了深度学习在目标鱼类识别任务上的部分实例。

图2 深度学习在目标鱼类识别任务上部分实例

Fig.2 Some examples about deep learning on target fish recognition task

3.2 鱼类计数与运动轨迹追踪

鱼类计数与运动轨迹追踪任务旨在统计水域中的鱼类数量,并通过轨迹追踪技术记录其运动轨迹。研究水下鱼类计数与运动轨迹追踪,就必须面对在二维图像上执行三维计数和轨迹追踪的难题,这就使得对被遮挡的鱼类进行计数和轨迹追踪成为了该研究的主要问题。

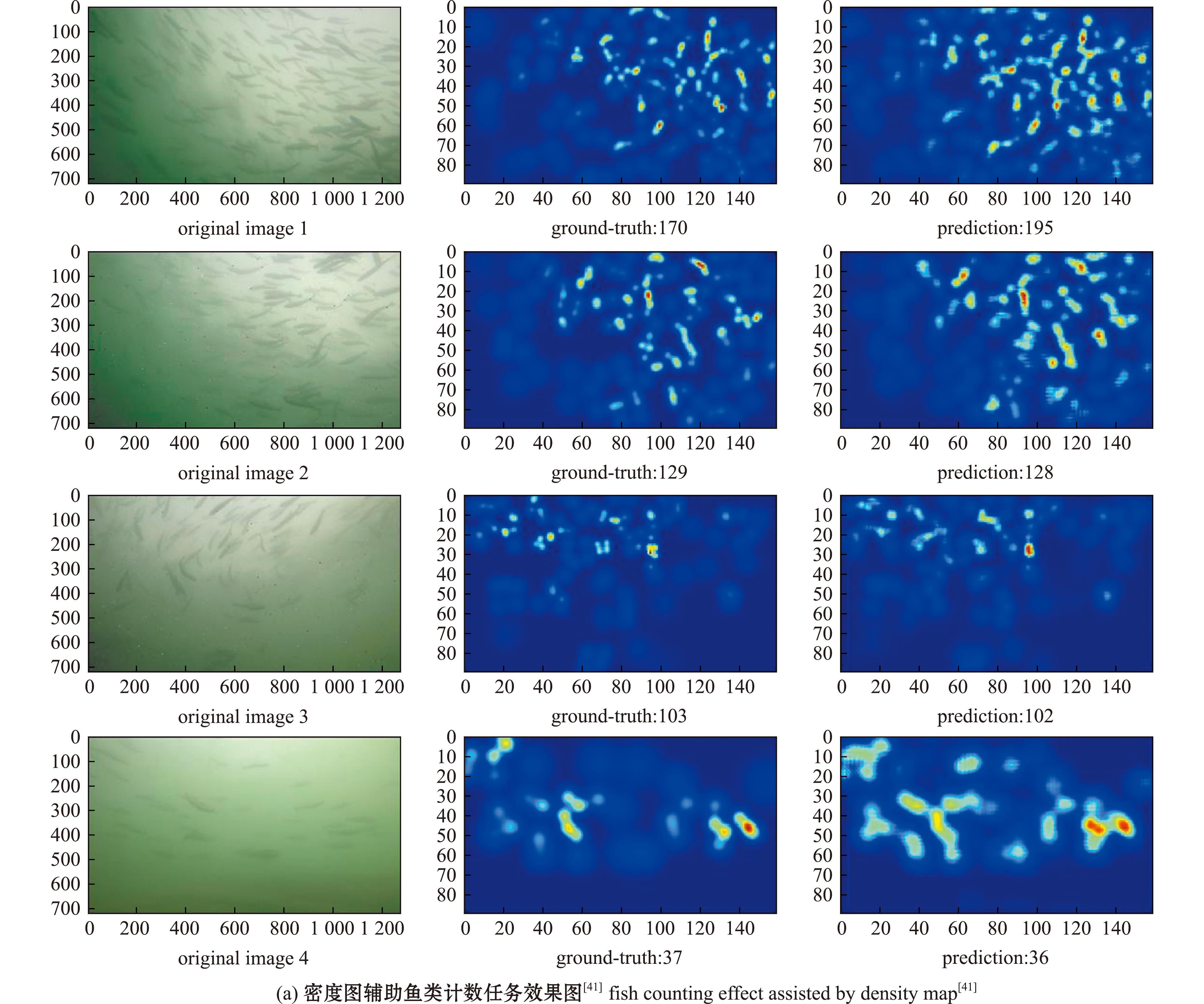

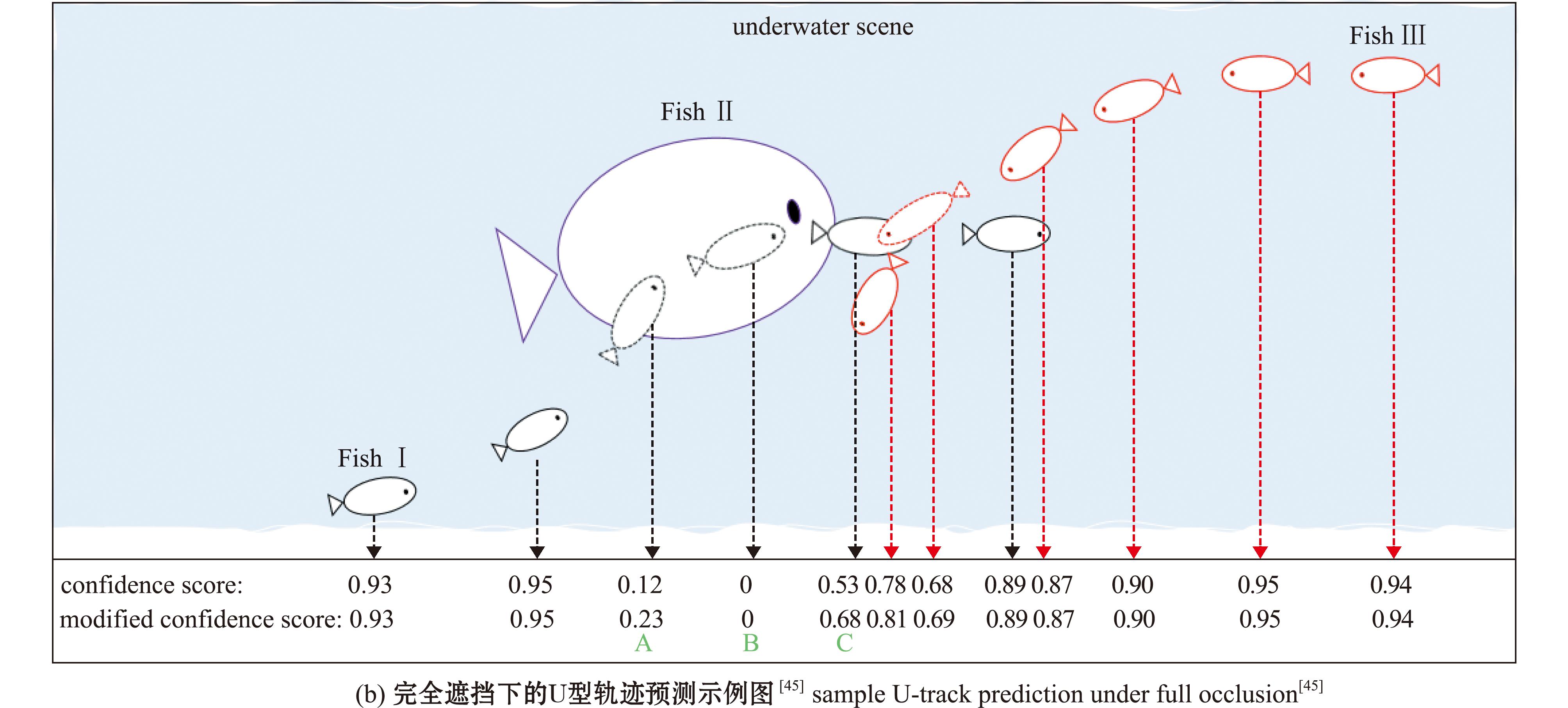

在计数方面,使用密度图可以帮助模型在遮挡条件下更好地理解鱼类分布,这能显著提升三维空间内鱼群的计数性能[41]。此外,使用分割也能在遮挡条件下取得不错的结果[42]。此外,为了提高计数任务中模型的稳定性和鲁棒性,还需要提升其多尺度适应能力以及识别容错能力。现有的计数研究中,采取多列卷积和动态计数缓冲门的方法能够达到以上目的[41,43]。在轨迹追踪方面,通常需要将轨迹追踪算法结合如下方法才能缓解遮挡难题:① 添加可变卷积网络(deformable convolutional network,DCN)结构,以增强模型识别因扭动和遮挡而在图像中急剧形变的鱼类的能力[43-44];② 追踪目标丢失后,重新分配ID[44-45];③ 鱼类运动轨迹预测[45]。由于轨迹追踪任务的需求是追踪大量运动鱼类的时间序列信息,该过程计算开销大。对于这个问题,李健源等[46]在部署模型时使用了NVIDIA的TensorRT库加速推理过程一定程度上解决了这个问题。

目前,鱼类轨迹追踪的研究瓶颈主要来自于遮挡条件下的追踪精度较低和追踪鱼类数量的上限。未来研究应重点提高在遮挡条件下的追踪精度,并降低模型的硬件资源消耗。此外,应将计数功能纳入轨迹追踪任务中,以实现更全面的鱼类监测。

图3展示了深度学习在鱼类计数与轨迹追踪任务上的部分实例。

图3 深度学习在鱼类计数与轨迹追踪任务上部分实例

Fig.3 Some examples on deep learning in fish counting and tracking tasks

3.3 鱼体特征识别

鱼体特征识别任务通常涉及对鱼的多种特征进行识别和估计,包括鱼的尺寸、质量、新鲜度及是否患病等。

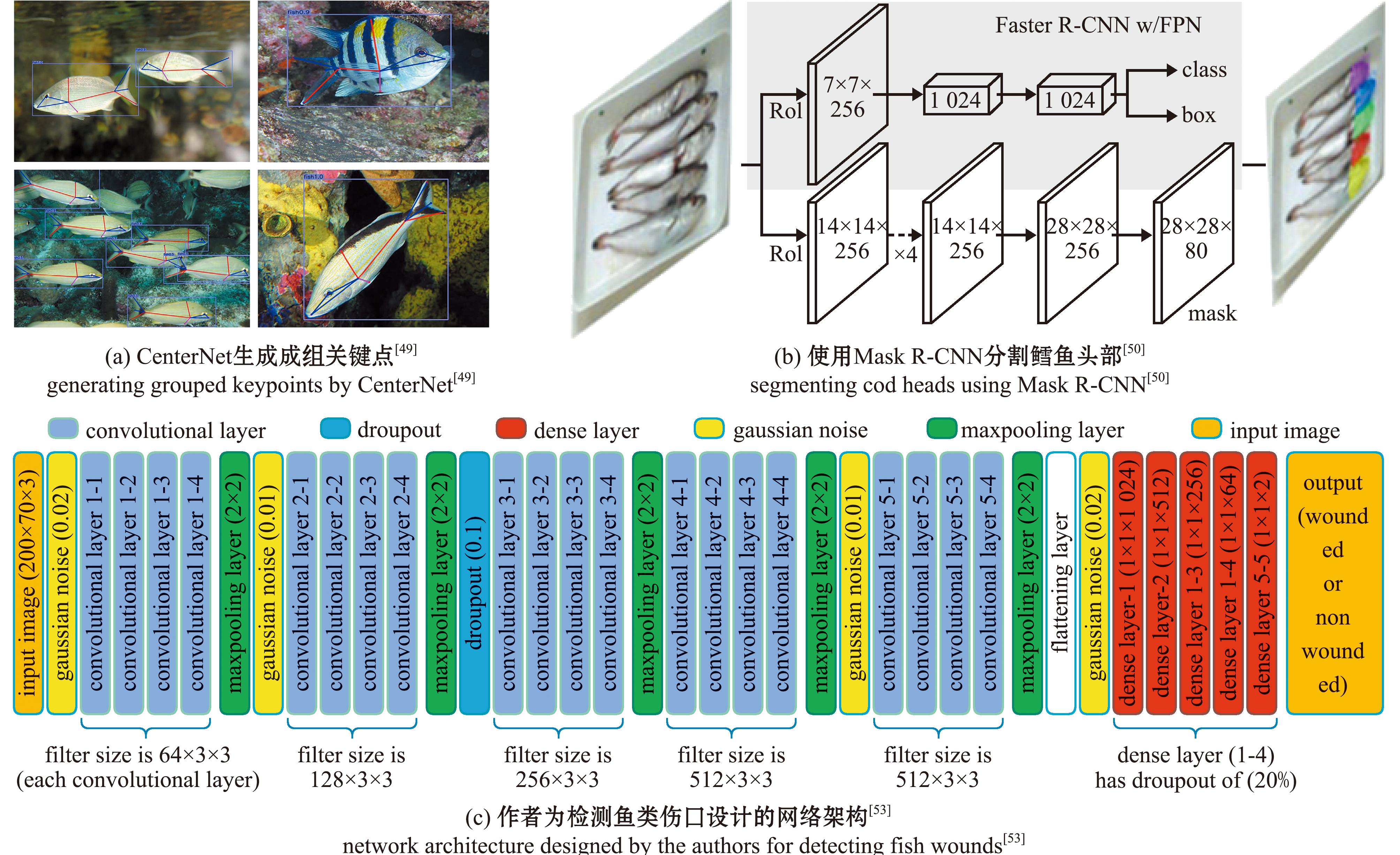

估计鱼类尺寸常采用基于图像分析的技术,通过确定鱼体的轮廓或关键部位来估算鱼的尺寸。现有研究中通常会采用图像分割或直接识别鱼的嘴部和尾部关键点的方法来寻找鱼的尺寸极点[47-48],但这些方法没有考虑到不同鱼的关键点相互混淆、部分遮挡导致被识别鱼类的关键点或者轮廓缺失,以及鱼类在挣扎、扭动的过程中造成长度估计上的偏差。对此,已有的研究分别采用如下方法解决这些问题:一是设置成组关键点,避免不同鱼的尺寸极点混淆[49],但无法应对关键部分受到遮挡的问题;二是找出鱼类头部与鱼体长之间的经验公式,再分割鱼头找出极点,进而估计鱼体尺寸[50]。该方法既能估计鱼身被遮挡的情况,又能避免鱼类扭动产生的尺寸估计偏差;三是使用双目立体视觉系统进行三维视图重建,能够减小扭动偏差[49],但增加了计算开销;四是持续追踪估计,选择最大尺寸作为估计结果也能达到减小扭动偏差的效果[51],但受限于追踪算法的性能。目前关于质量估计的研究较少,且这些研究通常需要将尺寸作为回归模型的输入参数,进而估计鱼类质量。由于估计的尺寸存在一定偏差,将存在偏差的结果作为输入参数会进一步放大质量估计的偏差,故质量估计效果较差[48]。

目前,绝大多数鱼体参数估计的研究条件都是基于固定机位和固定距离,这限制了其在水下的应用发展,也抑制了更多、更高级鱼类识别应用的衍生。未来鱼体特征识别估计的发展方向应当是将研究建立在非固定机位或非固定距离的前提之上。

鉴别新鲜度和病体鱼的任务与一般识别任务的方法策略相差较小。该任务通常仅需要把握鱼眼,鱼鳃、鱼皮的色泽和纹理等主要特征作为重要识别指标,故提升模型的表征能力或减少识别干扰是该项任务的关键。在提升表征能力方面研究者使用了块注意力机制(block attention mechanism,BAM)、稠密层、空间注意力机制(spatial attention mechanism,SAM)等模块[52-54]。此外,还能采用类激活映射(class activation mapping,CAM)生成可视化热图帮助研究者分析重要特征区域,以便调整超参数提高决定性特征的决策权重[55]。在减少识别干扰方面可以使用前文中所提到的旋转边界框、分割辅助预测等方法,也可以使用高斯滤波和双边滤波降低图像噪声[54]。

鉴别鱼类新鲜度的研究受限于光照条件,而病鱼的识别受限于水下的清晰度,目前几乎没有将这些纳入应用条件的研究。未来,鉴别鱼类新鲜度的研究应增强对光照变化的适应性,病鱼识别应在水下模糊环境中进一步研究。图4展示了深度学习在鱼体特征识别任务的部分实例。

图4 深度学习在鱼体特征识别任务上部分实例

Fig.4 Some examples about deep learning on fish feature recognition task

3.4 鱼类行为识别

现有的鱼类行为识别可以分为两种类型:一是鱼群行为识别;二是个体行为识别。

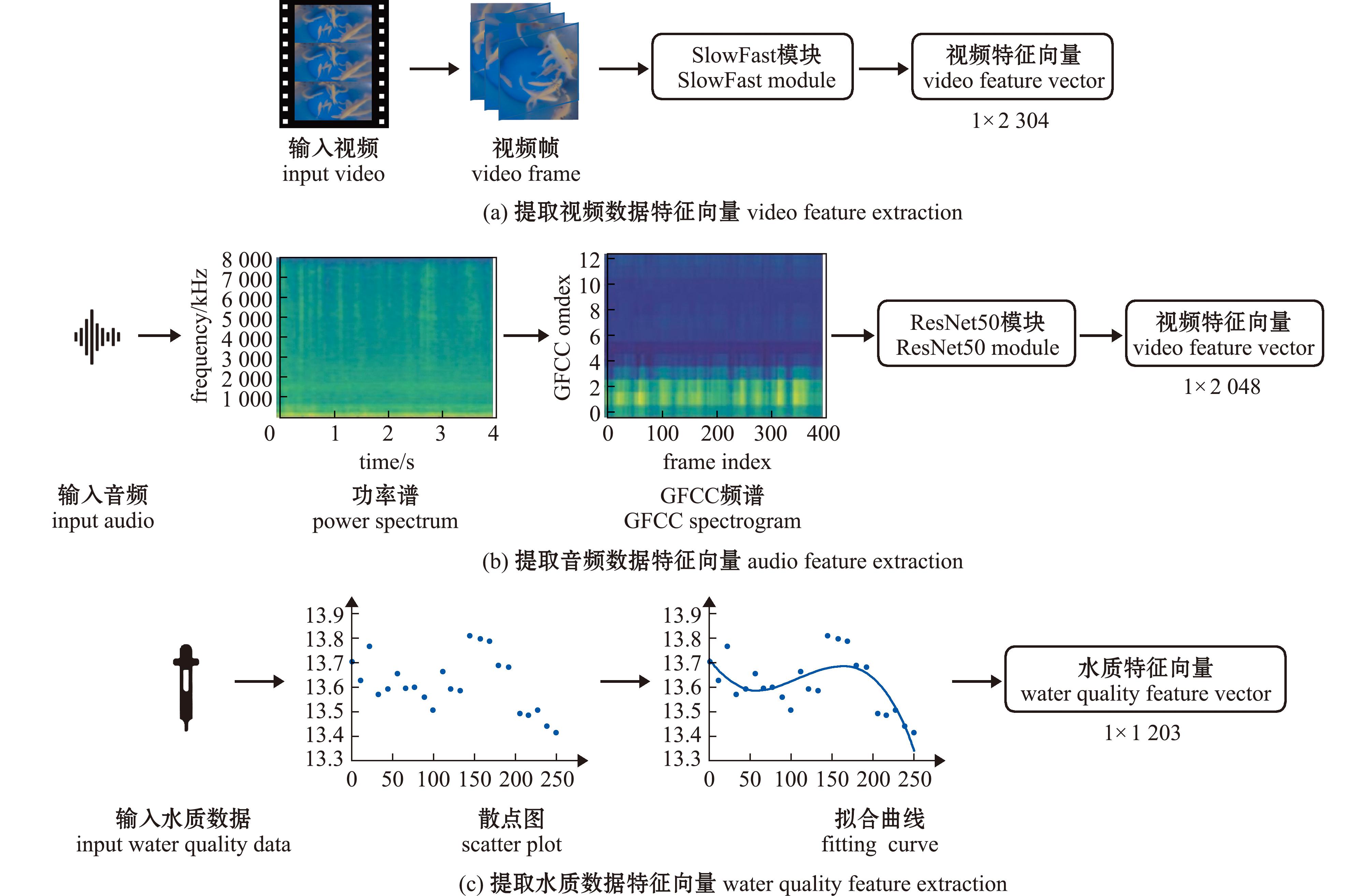

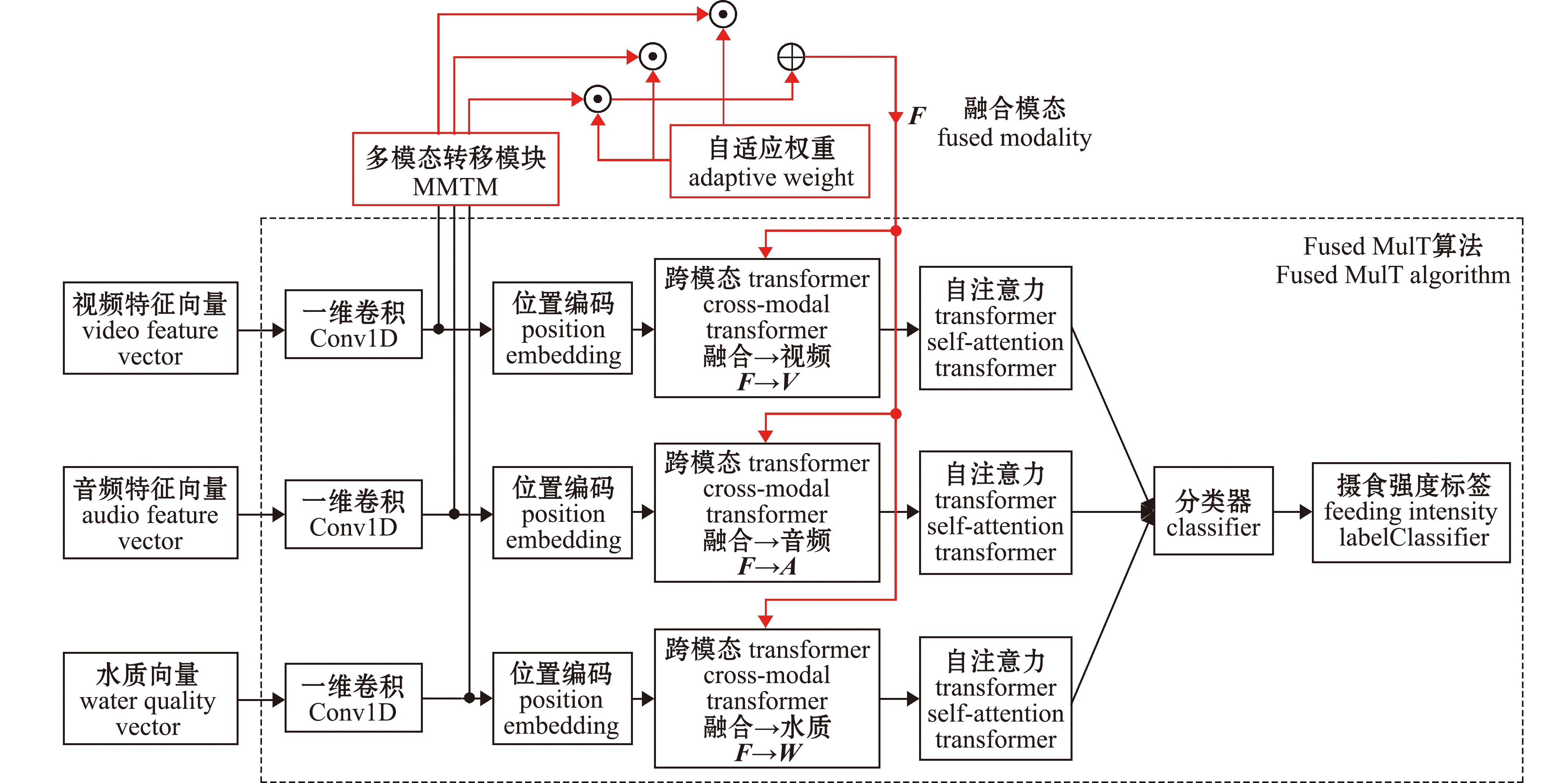

鱼群行为识别聚焦于整体的活动特征,这些活动特征能够体现出鱼群在特定环境下的集体反应,其研究内容通常包括鱼群的饥饿状态、摄食强度和活跃度等[56-60]。尽管这些研究任务存在差异性,但其主要研究思路相同,都采用深度学习算法识别水面或水下的鱼群分布情况,建立鱼群分布与行为之间的联系,进而推演出鱼群的行为状态。在提高模型识别鱼群分布的精度方面,可以采用知识蒸馏和3D卷积等方法[59-60]。知识蒸馏利用复杂模型辅助简单模型学习,尽可能地提高学习效率;3D卷积通过额外捕捉时间维度上的特征,进而提升动态行为的识别精度。在提高模型推演鱼群行为状态方面,可以采用多模态融合的方法,如胡学龙等[57]使用多模态 Transformer 融合水质、声音和图像3个方面的特征来识别摄食强度。这些方法能够取得不错的效果,但其难以进一步细化鱼群的行为强度。由于群体行为是多个个体行为的综合表现,不同个体行为发生的初始时间点和持续性都存在差异,进而导致鱼群行为识别既容易出现行为始末的延迟,又容易受到个体行为扰动的影响。

相比之下,个体行为识别的研究更加复杂且具有挑战性。个体行为需要置于群体中研究才有更大意义,但在实际操作中既需要解决鱼类之间的遮挡问题,又需要准确跟踪鱼类个体的运动轨迹。然而,水下环境的复杂性给这一过程增加了难度,如光线弱、悬浮颗粒多、视野受限等问题,不仅影响摄像头的捕获范围,还直接降低了图像或视频数据的质量。此外,多目标识别与轨迹追踪技术的发展还不够成熟,使得在复杂环境中对多个个体行为进行精确识别变得更加困难。这就导致大多数的鱼类行为识别研究都是基于群体的,仅有少部分研究通过编码鱼类的泳姿,将鱼的运动简化为坐标时间序列,最终实现了鱼群中个体行为识别[61]。

尽管已有研究在识别鱼群中个体行为的任务上取得了不错的结果,但该领域还有许多方法和模型尚待研究者挖掘。因此,未来识别鱼群中的个体行为研究可以重点关注更高效的遮挡处理方法、更智能的目标跟踪策略,以及更加准确的行为模式分析方法。图5~图7展示了深度学习在鱼类行为识别任务上的部分实例。

图5 多模态Transformer融合水质、声音和图像三方面特征[57]

Fig.5 Multimodal transformer fusion with water,sound and image features[57]

图6 模态融合检测鱼类摄食强度模型架构[57]

Fig.6 Model architecture of multimodal fusion to detect fish feeding intensity [57]

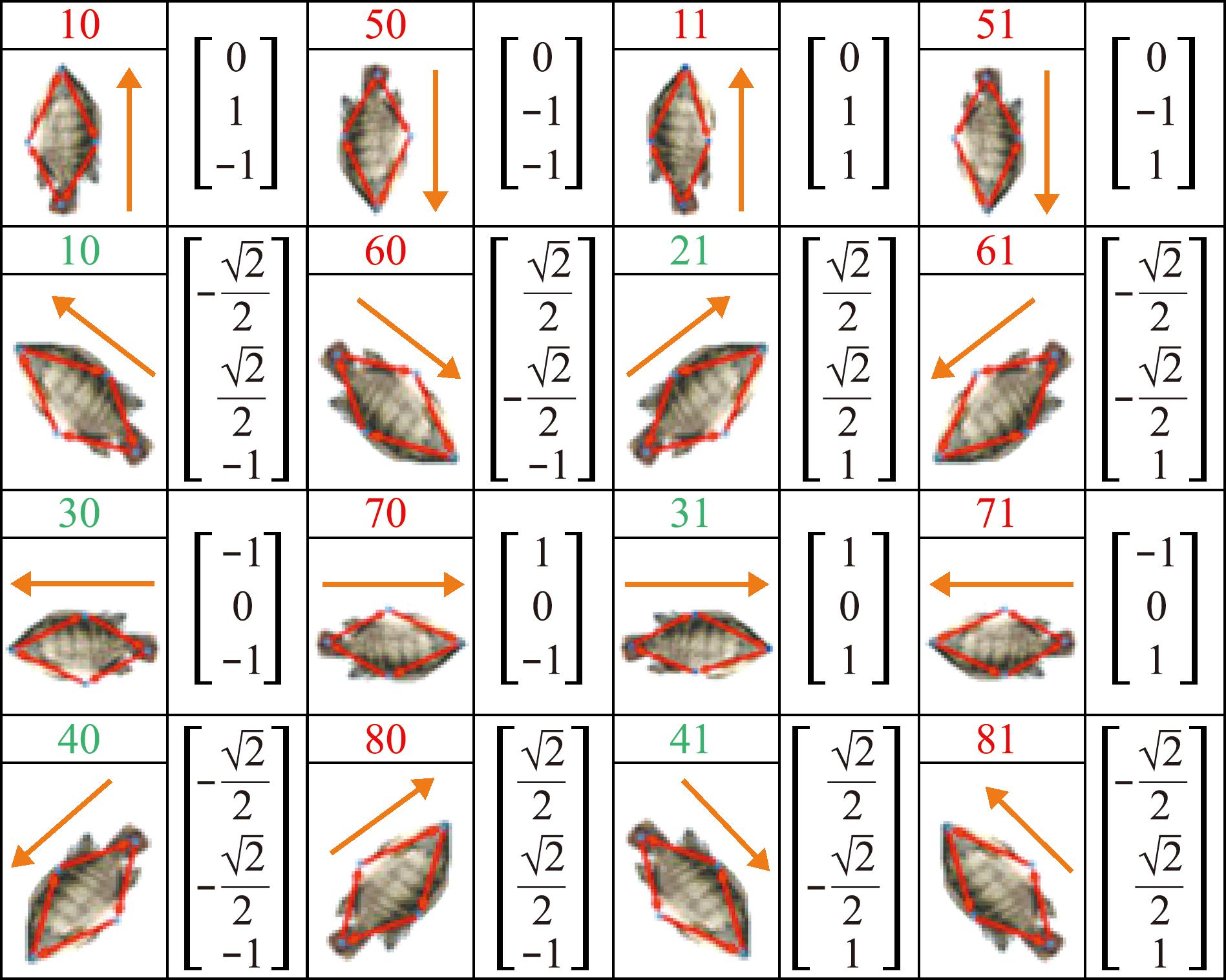

图7 泳姿编码示例[61]

Fig.7 Swimming posture coding example[61]

4 存在问题及展望

4.1 深度学习在鱼类识别中存在的问题

虽然深度学习与鱼类识别的结合已有近十年之久,但至今仍在数据质量、应用水平和接口统一等方面存在诸多问题。

1) 鉴于不同识别任务的特性和大多数研究的数据集无法公开获取,这使得当下许多研究都是基于自行收集并标注的数据进行的,而这类研究未能在多个数据集上进行验证,故研究所提出的模型泛化能力未知,模型存在性能不稳定的缺陷。虽然已有不少开源的鱼类数据集可供研究者使用,但仍然无类似Microsoft COCO般权威性的高质量数据集出现。

2) 近年来越来越多的新技术和新方法被应用到该类任务中,但在复杂的背景干扰、高度相似的鱼类形态特征及多变的水下光照条件下应用仍需克服诸多挑战。此外,鱼类的识别场景、识别目的与其他识别任务存在一定差异性,这导致其他领域的技术和方法的直接应用无法完全满足鱼类识别、追踪和计数的需求。并且当前在鱼类计数、轨迹追踪和鱼体特征识别等高级鱼类识别任务的应用水平上仍不成熟,检测效果达不到高精度和高稳定的状态。因此,这些任务难以进一步衍生出更高水平任务。

3) 不同设备能够支持的深度学习模型接口存在一定差异性,这意味着研究团队在选择深度学习模型进行开发时,会受到合作公司提供的设备接口限制,这一点严重抑制了深度学习在鱼类识别应用中的创新性,也使得许多性能优秀的模型无法与鱼类识别任务相结合。此外,还有一个十分棘手的问题,更换最新的硬件设备时,由于设备进行了升级、换代,其接口支持的深度学习模型版本也随之变化,这一改变需要大量的资源来更新、维护和调整先前的模型。

4) 鱼类识别领域的研究往往需要多个学科的深度融合,如计算机科学、生态学、渔业管理和水下工程学等。然而,由于学科背景的不同,研究者对整个研究和应用过程的参与覆盖率不高,使得研究者对其他环节的关键信息了解有限,从而制约了跨学科创新的切入点。这种分段式参与模式造成的信息割裂限制了创新入手点的广度,也影响了研究成果的深度,进而造成创新方法在理论上可行,但在数据采集、环境适应性或实际部署上却存在难以弥补的缺陷。此外,这种缺乏学科间深度融合的现状也使得研究者难以形成对问题全局的系统性认知,从而错失了潜在的突破方向。

5) 将深度学习应用于鱼类识别任务时,学科交叉的问题不可避免。通常,新进入该领域的研究人员仅具备单一方面的知识,缺乏对另一领域的理解,从而难以准确找到研究的切入点。虽然使用AI 工具如ChatGPT等可以快速检索信息、分析数据和制定策略,但这些工具的输出内容受到研究人员自身知识水平的限制,且存在错误和数据泄露的风险。此外,在处理专业问题时,ChatGPT等AI检索工具暴露出信息滞后、缺乏创新力等问题。

4.2 展望

目前,深度学习在鱼类识别任务上的应用已进入稳定发展的阶段,不少识别鱼类的模型已经投入到实际应用的场景中,但解决上述问题依旧具有极大的潜在价值。

1) 构建该领域权威性的高质量数据集需要远超单个研究团队的人力和财力,但当下研究鱼类识别任务的研究团队间合作较少,共同参与构建高质量数据集可以促进多个团队之间的研究合作。此外,构建权威性数据集意味着制定并推广统一的模型泛化能力测试标准,使得不同研究之间具有可比性,进而使研究工作方向更加明确,加速了深度学习在该任务上的应用发展。

2) 将其他领域的技术和方法引入到该领域既要考虑到近似的识别场景和识别目的,又要考虑在有差异的方面进行创新。此外,对密集或遮挡条件下的鱼类计数和轨迹追踪进一步研究具有重大意义。可以设想,当这类高级鱼类识别任务足够成熟后,必定会拓展出难度更大、实用性更强和智能化更高的任务,如鱼类计数与鱼体参数估计结合能够实现养殖场智能产量估计、鱼体特征识别与轨迹追踪,以及鱼类行为识别结合能够实现养殖场智能鱼群健康评估等。

3) 完成设备模型之间的接口统一化有助于解决不同设备之间的兼容问题,这使研究团队可更加灵活地根据任务需求选择设备和深度学习模型,进而推动深度学习在鱼类识别任务上的应用创新,并减少不必要的维护成本。

4) 建立跨学科协作平台,为鱼类识别、计数和追踪领域的研究者提供一个共享知识和资源的环境,从而打破学科壁垒,促进深度融合。此外,倡导多视角科研参与机制,有利于研究者发现理论与实践间的差距,还有利于在不同研究环节中寻找到更具突破性的创新切入点,推动鱼类识别、计数和追踪等技术的进一步发展和应用。

5) ChatGPT等AI检索工具的进一步智能化,将为深度学习在鱼类识别任务中的跨学科研究者提供更准确、更全面的信息,从而克服学科障碍,更容易找到研究切入点。此外,在确保数据安全的前提下,智能 AI工具在渔业数据分析、资源管理和技术信息支持方面的应用将更加广泛。如智能化工厂养殖管理可以通过 ChatGPT 分析大量数据,优化养殖策略,提高生产效率。同时,实时健康监测和病害预警功能能够保障养殖动物的健康,减少经济损失。

[1] 本刊讯.国务院新闻办公室发布《中国的远洋渔业发展》白皮书[J].中国水产,2023(11):2-4.BEN K X.The State Council Information Office of the People’s Republic of China 《Development of China’s Distant-Water Fisheries》[J].China Fisheries,2023(11):2-4.(in Chinese)

[2] 汤永华,张志鹏,林森,等.基于深度学习的鱼类识别相关技术研究现状及展望[J].海洋渔业,2024,46(2):246-256.TANG Y H,ZHANG Z P,LIN S,et al.Review and prospect of fish recognition and related techniques based on deep learning[J].Marine Fisheries,2024,46(2):246-256.(in Chinese)

[3] 闫党康.基于改进的Mask R-CNN的鱼类识别算法研究[J].计算机与数字工程,2023,51(6):1238-1243.YAN D K.Research on fish recognition algorithm based on improved mask R-CNN[J].Computer and Digital Engineering,2023,51(6):1238-1243.(in Chinese)

[4] 张然,林龙山,李渊,等.南沙群岛西南部和北部湾口海域鲨鱼的种类组成和数量分布[J].海洋渔业,2018,40(1):27-37.ZHANG R,LIN L S,LI Y,et al.Species composition and quantity distribution of sharks in the southwestern sea of the Nansha lslands and mouth of the Beibu Bay[J].Marine Fisheries,2018,40(1):27-37.(in Chinese)

[5] 魏凯,陈春山,张旭光,等.鱼类嗅觉系统功能与行为生态研究进展[J].海洋渔业,2017,39(6):723-730.WEI K,CHEN C S,ZHANG X G,et al.Review on olfactory organ and behaviour in fish[J].Marine Fisheries,2017,39(6):723-730.(in Chinese)

[6] 许竞翔,欧阳建,邱懿,等.基于改进YOLOv5 的水产养殖细菌性鱼病病原细菌检测算法[J].渔业现代化,2022,49(2):60-67.XU J X,OUYANG J,QIU Y,et al.Detection algorithm of pathogenic bacteria of aquaculture bacterial fish disease based on improved YOLOv5[J].Fishery Modernization,2022,49(2):60-67.(in Chinese)

[7] 李振波,赵远洋,杨普,等.基于机器视觉的鱼体长度测量研究综述[J].农业机械学报,2021,52(sup1):207-218.LI Z B,ZHAO Y Y,YANG P,et al.Review of research on fish body length measurement based on machine vision[J].Transactions of the Chinese Society of Agricultural Machinery,2021,52(sup1):207-218.(in Chinese)

[8] VANTREECK R,VAN WICHELEN J,WOLTER C.Fish species sensitivity classification for environmental impact assessment,conservation and restoration planning[J].Science of the Total Environment,2020,708:135173.

[9] PATTENGILL-SEMMENS C V,SEMMENS B X.Conservation and management applications of the reef volunteer fish monitoring program[C]//Coastal Monitoring through Partnerships:Proceedings of the Fifth Symposium on the Environmental Monitoring and Assessment Program (EMAP) Pensacola Beach,FL,USA,April 24-27,2001.Springer Netherlands,2003:43-50.

[10] 韩辰希,刘惠义,商国中.视觉显著性纹理—色彩特征融合的图像目标分类[J].电子测量技术,2017,40(11):94-98.HAN C X,LIU H Y,SHANG G Z.Vision saliency texture-color feature fusion basedobject classification[J].Electronic Measurement Technology,2017,40(11):94-98.(in Chinese)

[11] LECUN Y,BENGIO Y,HINTON G.Deep learning[J].Nature,2015,521(7553):436-444.

[12] 周飞燕,金林鹏,董军.卷积神经网络研究综述[J].计算机学报,2017,40(6):1229-1251.ZHOU F Y,JIN L P,DONG J.Review of convolutional neural network[J].Chinese Journal of Computers,2017,40(6):1229-1251.(in Chinese)

[13] GIRSHICK R.Fast r-cnn[C]//Proceedings of the Ieee International Conference on Computer Vision,2015:1440-1448.

[14] LI X,SHANG M,QIN H,et al.Fast accurate fish detection and recognition of underwater images with fast r-cnn[C]//OCEANS 2015-MTS/IEEE Washington.IEEE,2015:1-5.

[15] HE K,ZHANG X,REN S,et al.Deep residual learning for image recognition[C]//Proceedings of the Ieee Conference on Computer Vision and Pattern Recognition,2016:770-778.

[16] LONG J,SHELHAMER E,DARRELL T.Fully convolutional networks for semantic segmentation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2015:3431-3440.

[17] REDMON J,DIVVALA S,GIRSHICK R,et al.You only look once:Unified,real-time object detection[C]//Proceedings of the IEEE Conference On Computer Vision And Pattern Recognition,2016:779-788.

[18] HOWARD A G,ZHU M,CHEN B,et al.Mobilenets:efficient convolutional neural networks for mobile vision applications[J].arXiv Preprint arXiv:1704.04861,2017.

[19] VASWANI A,SHAZEER N,PARMAR N,et al.Attention is all you need[J].Advances in Neural Information Processing Systems,2017(30):5998-6008.

[20] 王柯力,袁红春.基于迁移学习的水产动物图像识别方法[J].计算机应用,2018,38(5):1304-1308,1326.WANG K L,YUAN H C.Aquatic animal image classification method based on transfer learning[J].Joumnal of Computer Applications,2018,38(5):1304-1308,1326.(in Chinese)

[21] 张琳,葛艳,杜军威,等.改进FCOS网络的海洋鱼类目标检测[J].计算机系统应用,2023,32(3):309-315.ZHANG L,GE Y,DU J W,et al.Improved FCOS network for marine fish target detection[J].Computer Systems &Applications,2023,32(3):309-315.(in Chinese)

[22] 梅海彬,黄政,袁红春.基于YOLOv7模型改进的轻量级鱼类目标检测方法[J].大连海洋大学学报,2023,38(6):1032-1043.MEI H B,HUANG Z,YUAN H C.A lightweight fish object detection method improved based on the YOLOv7 model[J].Journal of Dalian Ocean University,2023,38(6):1032-1043.(in Chinese)

[23] YEH C H,LIN C H,KANG L W,et al.Lightweight deep neural network for joint learning of underwater object detection and color conversion[J].IEEE Transactions on Neural Networks and Learning Systems,2021,33(11):6129-6143.

[24] 涂万,于红,张鹏,等.基于通道非降维与空间协调注意力的改进YOLOv8养殖鱼群检测[J].大连海洋大学学报,2023,38(4):717-725.TU W,YU H,ZHANG P,et al.Farmed fish detection by improved YOLOv8 based on channel non-degradation with spatially coordinated attention[J].Journal of Dalian Ocean University,2023,38(4):717-725.(in Chinese)

[25] 葛艳,张亚婷,李海涛.基于特征融合的FL-BCNN鱼类识别算法研究[J].计算机应用与软件,2023,40(8):174-179,186.GE Y,ZHANG Y T,LI H T.Fl-BCNN fish recognition algorithm based on feature fusion[J].Computer Applications and Software,2023,40(8):174-179,186.(in Chinese)

[26] MATHUR M,VASUDEV D,SAHOO S,et al.CrosspooledFishNet:transfer learning based fish species classification model[J].Multimedia Tools and Applications,2020,79(41):31625-31643.

[27] LI D,SU H,JIANG K,et al.Fish face identification based on rotated object detection:dataset and exploration[J].Fishes,2022,7(5):219.

[28] 刘世晶,刘阳春,钱程,等.基于CycleGAN和注意力增强迁移学习的小样本鱼类识别[J].农业机械学报,2023,54(sup 1):296-302.LIU S J,LIU Y C,QIAN C,et al.Recognition of small sample cultured fish based on cyclegan and attention enhanced transfer learning[J].Transactions of the Chinese Society of Agricultural Machinery,2023,54(sup 1):296-302.(in Chinese)

[29] PARASCHIV M,PADRINO R,CASARI P,et al.Classification of underwater fish images and videos via very small convolutional neural networks[J].Journal of Marine Science and Engineering,2022,10(6):736.

[30] JALAL A,SALMAN A,MIAN A,et al.Fish detection and species classification in underwater environments using deep learning with temporal information[J].Ecological Informatics,2020,57:101088.

[31] 董绍江,刘伟,蔡巍巍,等.基于分层精简双线性注意力网络的鱼类识别[J].计算机工程与应用,2022,58(5):186-192.DONG S J,LIU W,CAI W W,et al.Fish recognition based on hierarchical compact bilinear attention network[J].Computer Engineering and Applications,2022,58(5):186-192.(in Chinese)

[32] WU F,ZHANG Y,WANG L,et al.A deep learning-based lightweight model for the detection of marine fishes[J].Journal of Marine Science and Engineering,2023,11(11):2156.

[33] WANG G,SHI B,YI X,et al.DiffusionFR:species recognition of fish in blurry scenarios via diffusion and attention[J].Animals,2024,14(3):499.

[34] CHEN Y,LING Y,ZHANG L.Accurate fish detection undermarine background noise based on the retinex enhancement algorithm and CNN[J].Journal of Marine Science and Engineering,2022,10(7):878.

[35] BENTAMOU A,BENZINOU A,NASREDDINE K.Targeted data augmentation and hierarchical classification with deep learning for fish species identification in underwater images[J].Journal of imaging,2022,8(8):214.

[36] LI E,WANG Q,ZHANG J,et al.Fish detection under occlusion using modified you only look once v8 integrating real-time detection transformer features[J].Applied Sciences,2023,13(23):12645.

[37] 韦思学,于红,张鹏,等.基于通道非降维注意力机制与改进YOLOv5的养殖鱼群检测[J].渔业现代化,2023,50(3):72-78.WEI S X,YU H,ZHANG P,et al.A farmed fish detection method based on a non- channel- downscaling attention mechanism and improved YOLOv5[J].Fishery Modernization,2023,50(3):72-78.(in Chinese)

[38] 赵梦,于红,李海清,等.融合SKNet与YOLOv5深度学习的养殖鱼群检测[J].大连海洋大学学报,2022,37(2):312-319.ZHAO M,YU H,LI H Q,et al.Detection of fish stocks by fused with SKNet and YOLOv5 deep learning[J].Journal of Dalian Ocean University,2022,37(2):312-319.(in Chinese)

[39] ZHAO M,WU J,YU H,et al.Fish detecting using YOLOv4 and CVAE in aquaculture ponds with a non-uniform strong reflection background[J].IEICE Transactions on Information and Systems,2023,106(5):715-725.

[40] LEKUNBERRI X,RUIZ J,QUINCOCES I,et al.Identification and measurement of tropical tuna species in purse seiner catches using computer vision and deep learning[J].Ecological Informatics,2022,67:101495.

[41] ZHANG S,YANG X,WANG Y,et al.Automatic fish population counting by machine vision and a hybrid deep neural network model[J].Animals,2020,10(2):364.

[42] TSENG C H,KUO Y F.Detecting and counting harvested fish and identifying fish types in electronic monitoring system videos using deep convolutional neural networks[J].ICES Journal of Marine Science,2020,77(4):1367-1378.

[43] 袁红春,史经伟.基于改进YOLOv7- tiny和动态检测门的金枪鱼自动检测与计数研究[J].渔业现代化,2023,50(6):74-83.YUAN H C,SHI J W.A study of automatically detecting and counting tunas based on improved YOLOv7- tiny and dynamic detection gate[J].Fishery Modernization,2023,50(6):74-83.(in Chinese)

[44] LI W,LI F,LI Z.CMFTNet:multiple fish tracking based on counterpoised JointNet[J].Computers and Electronics in Agriculture,2022,198:107018.

[45] LIU T,HE S,LIU H,et al.A robust underwater multiclass fish-school tracking algorithm[J].Remote Sensing,2022,14(16):4106.

[46] 李健源,柳春娜,卢晓春,等.基于改进YOLOv5s和TensorRT部署的鱼道过鱼监测[J].农业机械学报,2022,53(12):314-322.LI J Y,LIU C N,LU X C,et al.Fish passage monitoring based on lmproved YOLOv5s and TensorRT deployment[J].Transactions of the Chinese Society of Agricultural Machinery,2022,53(12):314-322.(in Chinese)

[47] TENGTRAIRAT N,WOO W L,PARATHAI P,et al.Non-intrusive fish weight estimation in turbid water using deep learning and regression models[J].Sensors,2022,22(14):5161.

[48] MARRABLE D,TIPPAYA S,BARKER K,et al.Generalised deep learning model for semi-automated length measurement of fish in stereo-BRUVS[J].Frontiers in Marine Science,2023,10:1171625.

[49] YU Y,ZHANG H,YUAN F.Key point detection method for fish size measurement based on deep learning[J].IET Image Processing,2023,17(14):4142-4158.

[50]  LVAREZ-ELLACUR

LVAREZ-ELLACUR A A,PALMER M,CATAL

A A,PALMER M,CATAL N I A,et al.Image-based,unsupervised estimation of fish size from commercial landings using deep learning[J].ICES Journal of Marine Science,2020,77(4):1330-1339.

N I A,et al.Image-based,unsupervised estimation of fish size from commercial landings using deep learning[J].ICES Journal of Marine Science,2020,77(4):1330-1339.

[51] ![]() P,MART

P,MART NEZ-PEIR

NEZ-PEIR J,ANDREU-GARC

J,ANDREU-GARC A G,et al.Impact evaluation of deep learning on image segmentation for automatic bluefin tuna sizing[J].Aquacultural Engineering,2022,99:102299.

A G,et al.Impact evaluation of deep learning on image segmentation for automatic bluefin tuna sizing[J].Aquacultural Engineering,2022,99:102299.

[52] JAYASUNDARA J,RAMANAYAKE R,SENARATH H,et al.Deep learning for automated fish grading[J].Journal of Agriculture and Food Research,2023,14:100711.

[53] GUPTA A,BRINGSDAL E,SALBUVIK N,et al.An accurate convolutional neural networks approach to wound detection for farmed salmon[C]//International Conference on Engineering Applications of Neural Networks.Cham:Springer International Publishing,2022:139-149.

[54] WANG Z,LIU H,ZHANG G,et al.Diseased fish detection in the underwater environment using an improved Yolov5 network for intensive aquaculture[J].Fishes,2023,8(3):169.

[55] 李振波,李萌,赵远洋,等.基于改进VGG-19卷积神经网络的冰鲜鲳鱼新鲜度评估方法[J].农业工程学报,2021,37(22):286-294.LI Z B,LI M,ZHAO Y Y,et al.Iced pomfret freshness evaluation method based on improved VGG-19 convolutional neural networks[J].Transactions of the Chinese Society of Agricultural Engineering,2021,37(22):286-294.(in Chinese)

[56] IQBAL U,LI D,AKHTER M.Intelligent diagnosis of fish behavior using deep learning method[J].Fishes,2022,7(4):201.

[57] 胡学龙,朱文韬,杨信廷,等.基于水质-声音-视觉融合的循环水养殖鱼类摄食强度识别[J].农业工程学报,2023,39(10):141-150.HU X L,ZHU W T,YANG X T,et al.Identification of feeding intensity in recirculating aquaculture fish using water quality-sound-vision fusion[J].Transactions of the Chinese Society of Agricultural Engineering,2023,39(10):141-150.(in Chinese)

[58] 徐立鸿,崔钰惠,刘世晶,等.基于帧间深度特征差分的大西洋鲑鱼群活跃度分类模型[J].农业机械学报,2023,54(11):259-265.XU L H,CUI Y H,LIU S J,et al.Classification model of Atlantic salmon activity intensity based on deep feature differencing between frames[J].Transactions of the Chinese Society of Agricultural Machinery,2023,54(11):259-265.(in Chinese)

[59] MEI S,CHEN Y,QIN H,et al.A method based on knowledge distillation for fish school stress state recognition in intensive aquaculture[J].CMES-Computer Modeling in Engineering &Sciences,2022,131(3):1315-1335.

[60] HU Z,LI X,XIE X Y,et al.Abnormal behavior recognition of underwater fish body based on C3D model[C]//Proceedings of the 2022 6th International Conference on Machine Learning and Soft Computing,2022:92-97.

[61] WANG J H,LEE S K,LAI Y C,et al.Anomalous behaviors detection for underwater fish using AI techniques[J].IEEE Access,2020,8:224372-224382.